В рамках конференции по высокопроизводительным вычислениями SC`19, в Денвере, США, компания NVIDIA представила эталонную платформу, позволяющую компаниям быстро создавать GPU-ускоренные серверы на базе ARM.

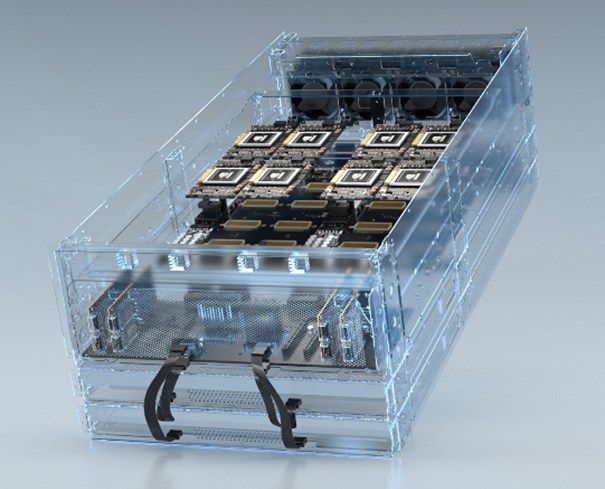

ARM становится убедительной платформой для инноваций в области искусственного интеллекта и высокопроизводительных вычислений. Теперь NVIDIA усиливает сотрудничество с ARM для развития эффективных вычислений в рамках одной экоплатформы. На конференции SC’19 Дженсен Хуанг, генеральный директор NVIDIA, представил технологический проект для компаний, позволяющий быстро и легко создавать серверы с GPU-ускорением и на базе ARM. Новая платформа позволяет супервычислительным центрам, облачным операторам и компаниями объединять преимущества ускоренной вычислительной платформы NVIDIA и новейших серверных платформ на базе ARM. Эталонная платформа, которая состоит из аппаратных и программных компонентов, предназначена для обеспечения более высокопроизводительных вычислений в быстро растущем диапазоне приложений для науки и исследований.

В рамках инициатив NVIDIA в сфере высокопроизводительных вычислений представлен набор программного обеспечения NVIDIA Magnum IO, позволяющий исследователям в области ИИ и HPC обрабатывать большие объемы данных за считанные минуты вместо нескольких часов. ПО Magnum IO устраняет узкие места при хранении и передаче данных, ускоряя до 20 раз обработку массивов данных в многосерверных мульти-GPU вычислительных узлах и позволяя быстро выполнять финансовый анализ, моделирование климата и другие HPC-задачи.

Также NVIDIA анонсировала доступность нового типа GPU-ускоренного суперкомпьютера в облаке Microsoft Azure.